2024年1月4日、米NIST(国立標準技術研究所)から、NIST AI 100-2e2023 “Adversarial Machine Learning: A Taxonomy and Terminology of Attacks and Mitigations”[1]という敵対的機械学習(Adversarial Machine Learning; AML)に関する報告書が発表されました。本書は、これまでに発表されたAMLに関する数多くの論文等を踏まえて、攻撃の分類と用語を整理し、それらの緩和措置を記述し、今後の課題について述べたものです。ドラフトが2023年3月に発表されていましたが、今回発表されたものが確定版となります。

本書においてAMLは、①AIシステムのタイプ(予測AIか生成AIか)、②学習手法と攻撃された時点での機械学習のライフサイクルプロセスの段階、③攻撃者の目標と目的、④攻撃者の能力、⑤学習プロセス等に関する攻撃者の知識、という5つの点に照らして分類されています。

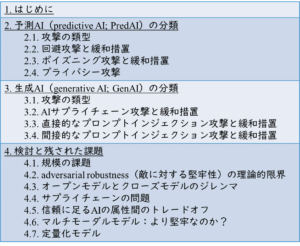

目次は下表の通りです。

2023年10月末のAI大統領令によれば、今後、生成AIについても2023年1月に発表されたAIリスクマネジメントフレームワーク(RMF)と同様の文書が発表されてくることが予想されます。その際は本報告書の問題意識が盛り込まれてくると思われます。

ご参考になりましたら幸いです。

[1]原文はこちら